Waarom vertrouwt u ons bedrijf?

We halen de paniek uit de inkoop. We hebben miljoenen moeilijk te vinden onderdelen uit onze vertrouwde bronnen op voorraad. We vernieuwen onze productvermeldingen met minuten en online aankopen worden in realtime voltooid en elke dag verzonden.

MFGChips, opgericht in 2002, is een lokale leider in de distributie van elektronische componenten en wordt tegenwoordig ook erkend als een van de meest gerespecteerde en innovatieve bedrijven op de lokale markt. MFGChips heeft zijn hoofdkantoor in Hong Kong en heeft een indrukwekkende reputatie opgebouwd voor het leveren van uitstekende service en het ontwikkelen van efficiënte, uitgebreide wereldwijde supply chain-oplossingen.

Kom meer te weten >

Memristortraining verlaagt de energiekosten van AI

Chinese onderzoekers maken gebruik van probabilistische updates op memristorhardware om het energieverbruik van AI-trainingen met ordes van grootte te verminderen, waardoor de weg wordt vrijgemaakt voor ultra-efficiënte elektronica.

Chinese wetenschappers hebben een doorbraak onthuld in het trainen van energievretende AI-modellen met behulp van memristorhardware, waardoor het energieverbruik met bijna zes ordes van grootte is verminderd in vergelijking met conventionele GPU-gebaseerde training.Hun nieuwe aanpak pakt een al lang bestaand probleem aan met de mismatch tussen hardware en software in op memristor gebaseerde neurale netwerken en zou energieprofielen voor de volgende generatie AI-elektronica kunnen hervormen.

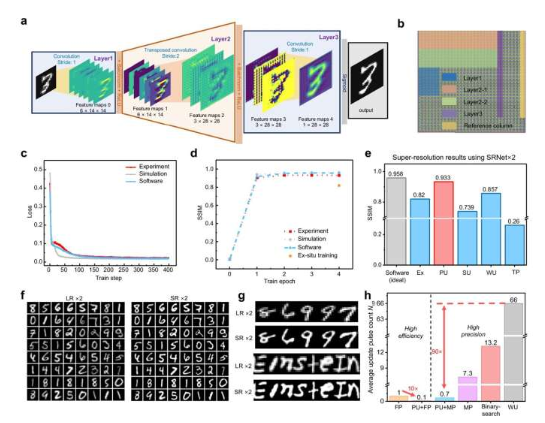

De kern van de vooruitgang is een foutbewust probabilistisch update-algoritme (EaPU) dat het luidruchtige, onvoorspelbare gedrag van memristorapparaten in lijn brengt met de op gradiënt gebaseerde gewichtsupdates die worden gebruikt bij neurale netwerktraining.Traditionele backpropagatie zorgt voor kleine, nauwkeurige aanpassingen aan de modelgewichten, maar analoge memristors die opslag en verwerking combineren, hebben last van schrijfruis en drift die zulke fijnmazige veranderingen ondermijnen.In plaats van die ruis te bestrijden, omarmt de EaPU-strategie stochasticiteit: het past waarschijnlijk grotere gewichtsverschuivingen toe terwijl updates onder de ruisdrempel van het apparaat worden overgeslagen, waardoor het aantal schrijfbewerkingen met meer dan 99% wordt verminderd en het energieverbruik dramatisch wordt verminderd.

Het team valideerde hun methode op een experimentele 180 nm memristorarray, trainingsnetwerken voor beeldruisonderdrukking en superresolutie met een kwaliteit die vergelijkbaar is met of beter is dan conventionele trainingsmethoden, maar waarbij slechts een klein deel van de energie wordt gebruikt.Grotere netwerken, waaronder 152-laags ResNets en Vision Transformers, werden tijdens simulatie getest, waarbij een nauwkeurigheidswinst van meer dan 60% op luidruchtige hardware werd aangetoond in vergelijking met standaardbenaderingen.

Naast energiebesparing verlengt de lagere updatefrequentie de levensduur van apparaten met ongeveer 1.000×, waardoor een belangrijke hindernis voor commerciële memristorsystemen wordt weggenomen.Vergeleken met eerdere memristortrainingsprogramma's verlaagt EaPU de trainingsenergie met ongeveer 50×, en ongeveer 13× vergeleken met het beste bestaande geoptimaliseerde algoritme.

Onderzoekers zien brede toepassingen voor hun techniek, en breiden deze mogelijk uit naar andere geheugentechnologieën zoals ferro-elektrische transistors en magnetoresistief RAM, en zelfs naar grootschalige AI-trainingsclusters waar energiekosten een strategische zorg zijn.Als dit werk wordt opgeschaald en gecommercialiseerd, kan het ertoe bijdragen dat duurzame, energie-efficiënte AI-elektronica een praktische realiteit wordt.